Monitorización del consumo eléctrico y de la temperatura y humedad(Parte 1)

Veremos el minimo hardware necesario para monitorizar nuestro consumo electrico junto con la temperatura y humedad

Veremos el minimo hardware necesario para monitorizar nuestro consumo electrico junto con la temperatura y humedad

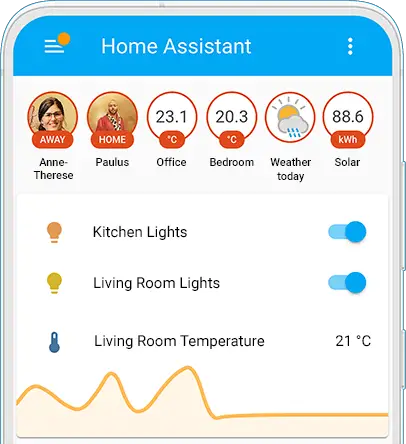

Usaremos una RPi para automatizar el hogar y como pieza sw fundamental HomAssistant que podemos encontrar ya preinstalado como imagen

Cayenne en 2013 sorprendió con una plataforma de IOT enfocada en la facilidad de cara al usuario. Tristemente tras 10 años han cerrado sus operaciones orientadas a pequeños desarrollos. Veamos en este post que alternativas podemos tener.

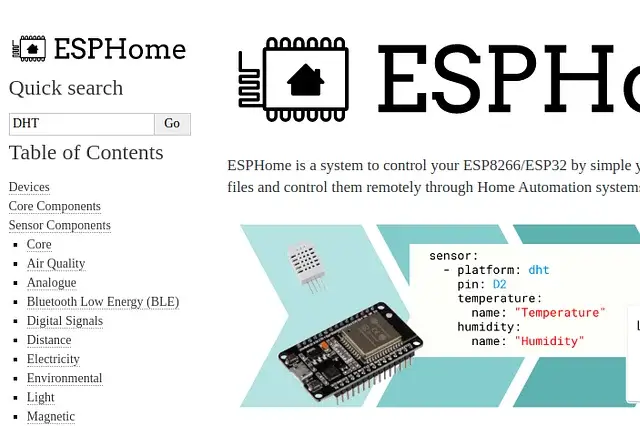

No es necesario programar apenas para usar un esp con esta potente herramienta que podemos usar para automatizar el hogar