LO ULTIMO

ULTIMOS POST

-

Cómo alargar la vida de tus equipos y ahorrar luz con una automatización barata

¿Sabías que el modo standby daña la electrónica de tus equipos y aumenta tu factura? Descubre cómo usar una automatización… READ MORE

-

Evita una inundación en vacaciones con sensores IoT

Una pequeña fuga de agua puede arruinar tus vacaciones y causar daños en casa o al vecino. Descubre cómo usar… READ MORE

-

Convierte un móvil Android antiguo en una herramienta para electrónica

Reutiliza un móvil o tablet Android como herramienta de taller: lupa, visor de endoscopio USB, generador de señales, calculadora electrónica,… READ MORE

-

Guía Maestra: Optimiza Windows 11 al Máximo y Automatiza tus Actualizaciones

Aprende a optimizar Windows 11 desactivando la telemetría y el rastreo innecesario. Descubre cómo usar WinGet y el script de… READ MORE

posts RECIENTES

La FRASE DEL MES

«Cualquier tecnología suficientemente avanzada es indistinguible de la magia.»

~ Arthur C. Clarke

Soloelectronicos.com

acerca de soloelectronicos

Bienvenido a SoloElectrónicos, tu laboratorio digital de hardware, reparaciones y soluciones tecnológicas.

En este blog nos apasiona la tecnología, pero no cualquier tecnología: nos interesa aquella que ayuda a mejorar la calidad de vida de las personas. Creemos firmemente en el poder del conocimiento compartido y en la filosofía Maker (hazlo tú mismo).

¿Qué encontrarás aquí?

Con más de 1.800 artículos publicados, este sitio se ha convertido en una enciclopedia práctica para entusiastas y profesionales. Nuestra temática abarca desde la electrónica más pura hasta la informática aplicada:

-Reparación y Mantenimiento: Guías paso a paso para dar una segunda vida a tus dispositivos.

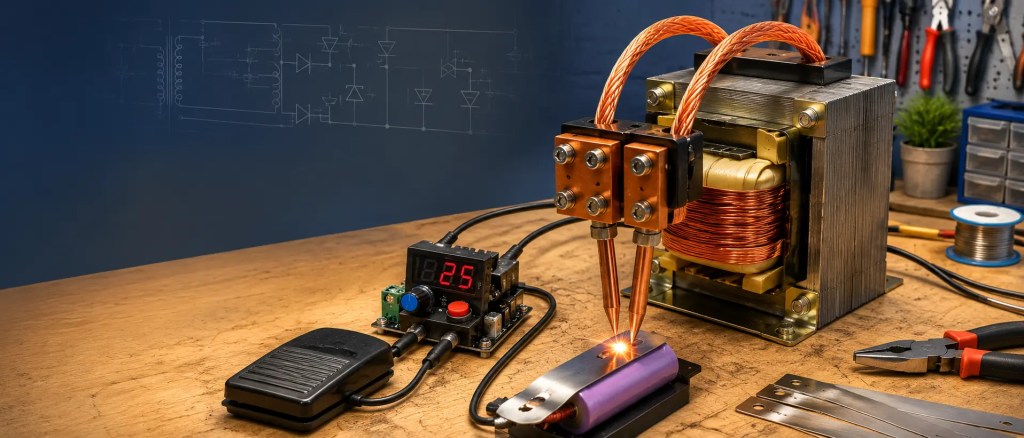

–Proyectos DIY y Arduino: Tutoriales para automatizar y crear soluciones personalizadas.

-Trucos de Hardware: Cómo aprovechar al máximo tus periféricos (como por ejemplo como convertir una tablet en un segundo monitor).

-Software Libre y Herramientas: Uso de herramientas libers que potencian nuestro trabajo.

Nuestra Filosofía

En un mundo donde la obsolescencia programada es la norma, en SoloElectrónicos apostamos por la reparación, la reutilización y el aprendizaje continuo. No importa si eres un ingeniero experto o alguien que acaba de comprar su primer soldador; aquí encontrarás soluciones explicadas de forma clara y directa.

¡Gracias por ser parte de esta comunidad tecnológica!

Temas

- Android

- Arduino

- audio y video

- Bloging

- bricolaje

- cloud computing

- comunicaciones e infraestructura de TI

- desarrollo de aplicaciones

- DISEÑO

- Domotica

- electronica de consumo y de entretenimiento

- Electronica de Potencia

- electronica del automovil

- Electronica General

- energia

- ESP32

- gadgets

- impresoras 3d

- informatica

- Innovación

- inteligencia artificial

- IoT

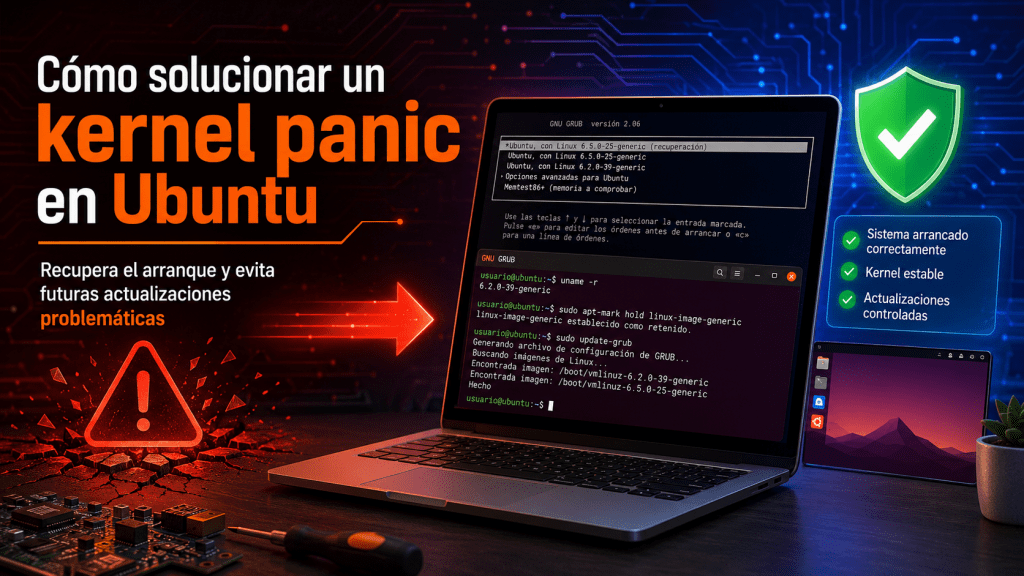

- linux

- M2M

- noticias tecnológicas

- ofimatica

- open hw

- open source

- PC's

- Raspberry

- reciclaje

- reparaciones

- sistemas operativos

- Utilidades y SW