Muchos aficionados se preguntan: ¿Se puede ejecutar una IA local desde un pendrive? La respuesta corta es sí, pero con un matiz importante: el pendrive no hace magia.

En SoloElectronicos nos gusta destripar el hardware, así que vamos a aclarar conceptos: la IA no se ejecuta «en el USB», sino en el ordenador. El pendrive solo actúa como almacenamiento del modelo y los ejecutables; el trabajo sucio lo hacen tu CPU, la RAM y la GPU.

Requisitos mínimos de hardware

Para que la experiencia no sea frustrante, olvida los equipos obsoletos. Esto es lo mínimo razonable:

- RAM: 8 GB mínimo (16 GB es lo ideal).

- CPU: Recomendable con soporte AVX2.

- GPU: No es obligatoria, pero con VRAM la velocidad es otro mundo.

- Almacenamiento: Aunque usamos un pendrive para portabilidad, un SSD externo siempre será más rápido y duradero.

El formato clave: GGUF

La magia de la IA doméstica actual se llama GGUF. Es un formato usado por herramientas como llama.cpp que permite «cuantizar» (comprimir) los modelos para que quepan en hardware normal sin perder demasiada inteligencia. Gracias a esto, puedes correr modelos como Llama, Gemma o Mistral en tu casa.

Ojo con la privacidad: Al correr en local, tus conversaciones no salen de tu equipo. Eso sí, desconfía de archivos

.batextraños. Ábrelos siempre con un editor de texto antes de ejecutarlos para verificar qué comandos contienen.

Guía Práctica: Usando llamafile (Mozilla)

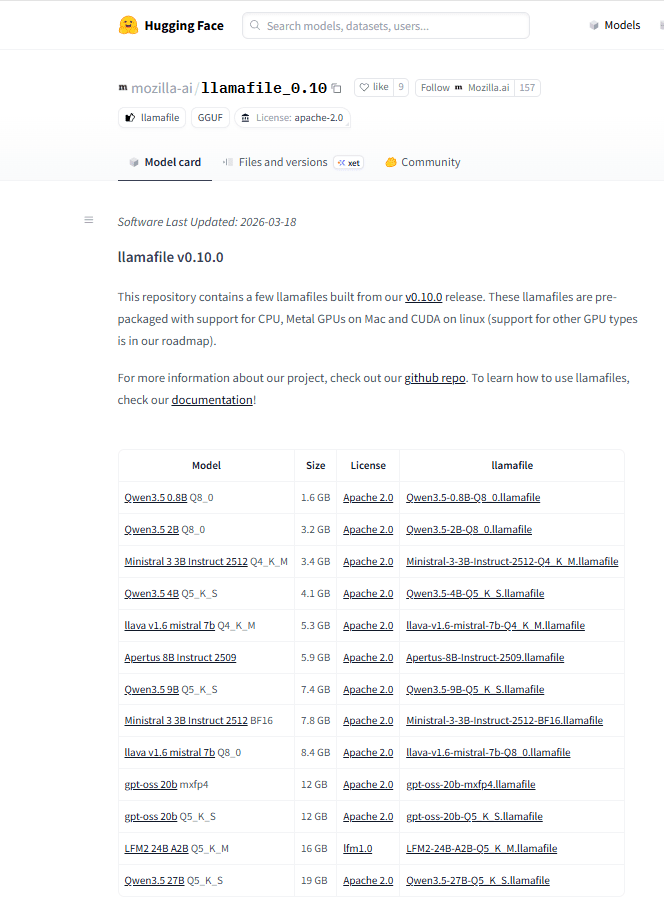

llamafile es un proyecto de Mozilla que convierte modelos de IA en ejecutables únicos. Es la forma más sencilla de llevarte una IA en el bolsillo.

Opción A: El camino fácil (Modelo empaquetado)

Descargas un solo archivo que ya incluye el cerebro de la IA. Por ejemplo, el modelo Qwen3.5 0.8B (pesa unos 1.6 GB).

- En Windows: Descarga el archivo, cámbiale la extensión a

.exe(ej.qwen.exe) y ejecútalo desde PowerShell:.\qwen.exe - En Linux/macOS:

chmod +x qwen.llamafile ./qwen.llamafile

Opción B: El camino flexible (Ejecutable + Modelo externo)

Esta opción es mejor si quieres probar diferentes modelos .gguf sin descargar el motor cada vez.

- Descarga el ejecutable base: llamafile-0.10.0

- Descarga cualquier modelo GGUF desde Hugging Face.

- Ejecuta como servidor local: Esto abrirá una interfaz en tu navegador (http://127.0.0.1:8080) muy parecida a ChatGPT, pero 100% privada y offline.

- E

n Windows:.\llamafile.exe -m mi_modelo.gguf --server --host 127.0.0.1 --port 8080 En Linux/macOS: ./llamafile -m mi_modelo.gguf --server --host 127.0.0.1 --port 8080

Alternativas recomendadas

Si llamafile no es lo tuyo, existen otras herramientas excelentes que hemos probado:

- LM Studio: La interfaz más visual y fácil para Windows/Mac.

- Ollama: Ideal para usuarios de terminal y servidores.

- GPT4All: Muy ligero y con instalador sencillo.

- Apple Silicon (Mac M1/M2/M3): Si tienes un Mac, la memoria unificada hace que la IA vuele. Usa MLX para el máximo rendimiento.

Conclusión

¿Sirve para imágenes o vídeo? Por ahora, estos modelos locales (LLMs) son principalmente para texto. Para imágenes necesitarías Stable Diffusion, que requiere mucha más potencia de GPU.

Mi consejo final: El pendrive es genial para llevar tu IA de un sitio a otro («IA portátil»), pero para el día a día, instálalo en tu SSD interno. Ganarás velocidad y evitarás degradar tu memoria USB prematuramente.

Deja un comentario