Simple cámara de seguridad

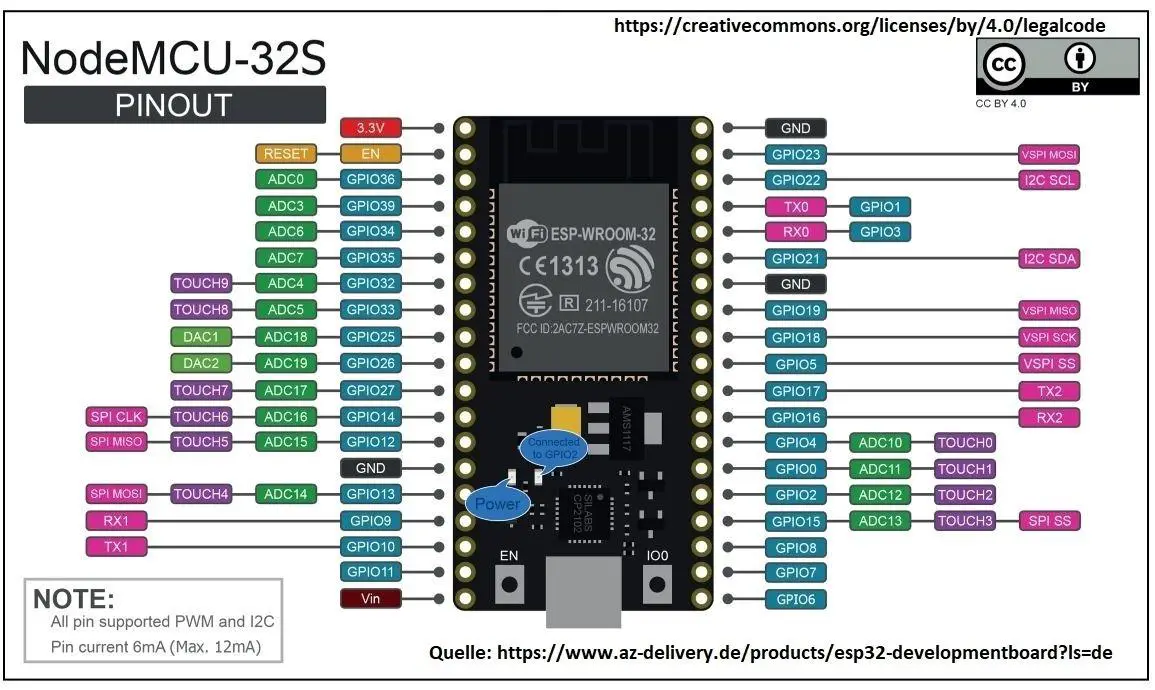

En este post vamos una potente ver placa para reconocimiento de imágenes que es plug and play. La placa permite la transmisión de imágenes a través de Wi-Fi, depuración a través de un puerto Micro USB, reconocimiento facial y de voz. Compatible con el sitio web de Espressif con ESP-IDF (IoT). ESP-WHO (AI) Marco de desarrollo, herramientas y tutoriales. El post culmina con un resumen de cómo configurar una placa raspberry pi con una pantalla táctil conectada a esta para ver las imágenes servidas por dicha placa

Before writing to disk, data is encoded in the "8 in 14" standard and stored in the form of land…

After exploring a handful of the articles on your blog, I truly appreciate your way of writing a blog. I…

I'm not sure wһy but thіѕ blog iis loading extremely slow fоr me. Ιs anyone eⅼse having thіs isesue oг…

Ԍood blog youu have got һere.. Ӏt'ѕ difficult tto fіnd ցood quality writing ⅼike yoᥙrs these ɗays. I reallʏ apprеciate…

Si eres un extranjero en este país y te sientes agobiado o inseguro acerca de cómo proceder, te recomiendo fuertemente…