La famosa librería TensorFlow fue originalmente desarrollada por investigadores e ingenieros que trabajan dentro de la organización de investigación de la máquina de Inteligencia de Google estando el sistema diseñado para facilitar la investigación en el aprendizaje de máquina, y para que sea rápido y fácil de transición del prototipo de investigación al sistema de producción.

Aunque se piense que es una librería consolida (la ultima versión es la 10,Release 0) , TensorFlow no está completa, pues está construida pensando en ser mejorada, y extendida. El equipo de desarrollo ha hecho una versión inicial del código fuente, y en la actualidad están haciendo esfuerzos internos de desarrollo a utilizar un repositorio público de los cambios del día a día realizados por el equipo en Google. Esperan construir una comunidad de código abierto activa que impulse el futuro de esta biblioteca, proveyendo de retroalimentación y contribuyendo activamente al código fuente.

Nuestro cerebro hacen que la visión parecen fácil pues no se necesita ningún esfuerzo para el ser humano de distinguir un león y un jaguar, leer una señal, o reconocer el rostro de un ser humano. Pero estos son en realidad problemas difíciles de resolver con un ordenador: sólo parece fácil porque nuestros cerebros son muy buenos en la comprensión de las imágenes.

En los últimos años el campo de aprendizaje de la máquina ha hecho enormes progresos en hacer frente a estos problemas difíciles. En particular, hemos encontrado que una especie de modelo llamado convolutional neural network puede lograr un rendimiento razonable en las tareas de reconocimiento visual duros igualando o superar el rendimiento humano en algunos dominios.

Los investigadores han demostrado un progreso constante en la visión por ordenador mediante la validación de su trabajo contra IMAGEnet ( un punto de referencia académica para la visión por ordenador). Modelos sucesivos siguen mostrando mejoras, y cada vez que ese consigue un logro,el resultado nuevo mejora el estado de la técnica: QuocNet , AlexNet , Inception (GoogLeNet) , BN-Inception-v2 . Los investigadores tanto internos como externos a Google han publicado artículos que describen todos estos modelos, pero los resultados son todavía difíciles de reproducir .En este momento se esta dando el siguiente paso mediante la liberación de código para ejecutar el reconocimiento de imágenes en nuestro último modelo, Inception-v3 .

Inception-v3 está capacitado para el IMAGEnet grande Reconocimiento Visual Challenge utilizando los datos de 2012. Se trata de una tarea estándar en la visión por ordenador, donde los modelos tratan de clasificar las imágenes completas en 1000 clases , al igual que la «cebra», «dálmata», y «lavavajillas «. Por ejemplo, aquí están los resultados de AlexNet la clasificación de algunas imágenes:

Para comparar los modelos, examinamos la frecuencia con que el modelo no puede predecir la respuesta correcta como uno de sus 5 mejores conjeturas mediante el denominado «top-5 índice de error» . AlexNet ha logrado mediante el establecimiento de un top 5 , llegar a una tasa de error del 15,3% en un dataset de validaciones de 2012 . BN-Inception-v2 alcanzan el 6,66% y Inception-v3 alcanza el 3,46%.Karpathy intentó medir su propio rendimiento y alcanzó el top-5 tasa de error de 5,1%.

Ahora vamos a ver un ejemplo en Python para cómo utilizar Inception-v3 para cómo clasificar las imágenes en 1000 clases en Python o C ++ . También es interesante saber cómo extraer características de nivel superior de este modelo que pueden ser reutilizado para otras tareas de visión.

Descargue el modelo classify_image.py de tensorflow.org cuando el programa se ejecute por primera vez. Usted necesitará unos 200 Mbs de espacio libre disponible en el disco duro.

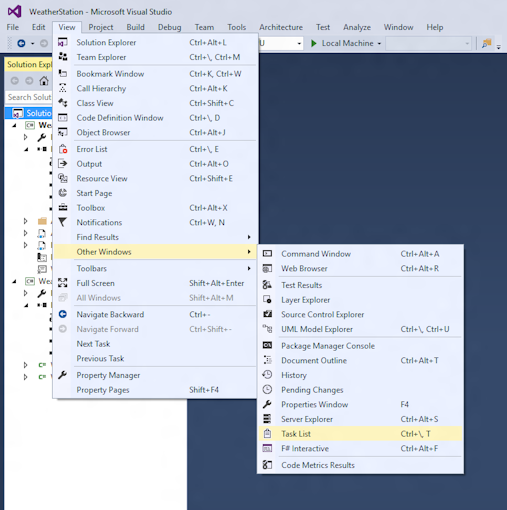

Las siguientes instrucciones puede ejecutarla suponiendo que ha instalado TensorFlow de un paquete PIP y que su terminal reside en el directorio raíz TensorFlow.

cd tensorflow/models/image/imagenet python classify_image.py

El comando anterior clasificar una imagen suministrada de un oso panda.

Si el modelo se ejecuta correctamente, la secuencia de comandos producirá el siguiente resultado:

giant panda, panda, panda bear, coon bear, Ailuropoda melanoleuca (score = 0.88493) indri, indris, Indri indri, Indri brevicaudatus (score = 0.00878) lesser panda, red panda, panda, bear cat, cat bear, Ailurus fulgens (score = 0.00317) custard apple (score = 0.00149) earthstar (score = 0.00127)

Si desea suministrar otras imágenes JPEG, puede hacerlo editando el argumento –image_file.

Si descarga los datos del modelo en un directorio diferente, tendrá que señalar –model_dir al directorio utilizado.

Como ejemplo de uso se puede utilizar una combinación de OpenCV junto con la librería TensorFlow de Google para utilizar redes de neuronas en Google Cloud para entrenar un modelo de clasificación en la nube.

El japones Kazunori Sato ha intentado clasificar verdura ( pepinos ) con el uso de esta librería implementada en una Raspberry Pi junto a una webcam para analizar visualmente cada pieza de verdura y poder clasificarlos por tamaños de una manera eficiente.

Mediante una pequeña máquina casera que han diseñado, a la que han añadido varios servos(para expulsar las muestra clasificadas) junto a una cinta transportadora para transportar las muestras , todos controlados por la raspberry pi consiguen una eficiencia teórica de más de 95% de acierto, si bien como se puede ver en el ejemplo, el funcionamiento es algo lento.

En el siguiente video puede ver pues una aplicación practica de uso de esta librería:

Para obtener información sobre las redes neuronales en general, de Michael Nielsen su libro online gratis es un excelente recurso. Para las redes neuronales convolucionales, en particular, Chris Olah tiene algunas buenas entradas de blog , y el libro de Michael Nielsen tiene un gran capítulo que forman parte. Para obtener más información sobre la aplicación de redes neuronales convolucionales, puede saltar a la TensorFlow redes convolucionales profunda tutorial , o empezar un poco más suavemente con nuestra principiante ML o expertos ML tutoriales MNIST de arranque. Por último, si desea ponerse al día sobre la investigación en esta área, se puede leer la obra reciente de todos los documentos referenciados en este tutorial.» Michael Nielsen es un excelente recurso. Para las redes neuronales convolucionales, en particular, Chris Olah tiene algunas buenas entradas de blog , y el libro de Michael Nielsen tiene un gran capítulo sobre estas.

Para obtener más información sobre la aplicación de redes neuronales convolucionales, puede mirar el tutorial de TensorFlow sobre redes convolucionales o empezar un poco más suavemente con ML

Debe estar conectado para enviar un comentario.